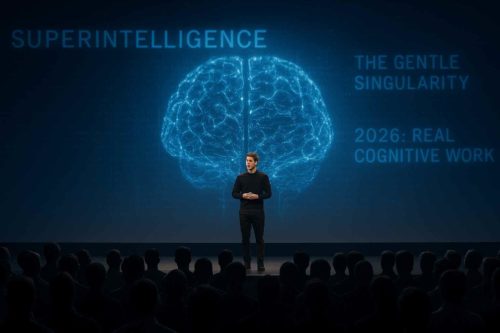

Fa uns dies, Sam Altman va publicar al seu blog personal The Gentle Singularity, un text que pretén ser una reflexió sobre el futur de la intel·ligència artificial. El CEO d’OpenAI hi exposa la seva visió d’un món transformat per la IA en els pròxims anys, amb prediccions específiques i afirmacions audaces sobre el que ens espera. Però llegint-lo, no puc evitar pensar que estem davant d’un exemple perfecte del tipus de discurs que alimenta l’analfabetisme tecnològic del qual parlàvem recentment.

L’art de vendre somnis amb dates concretes

Altman comença amb una afirmació rotunda: “ja hem passat l’horitzó d’esdeveniments; l’enlairament ha començat”. Segons ell, la singularitat tecnològica no és un esdeveniment futur, sinó una realitat present. ChatGPT, ens diu, “ja és més poderós que qualsevol humà que hagi viscut mai”. És una frase impactant, però també profundament enganyosa.

El que més em crida l’atenció és la seva cronologia detallada:

- 2025: Agents que faran “treball cognitiu real”

- 2026: Sistemes capaços de descobrir insights nous

- 2027: Robots operant al món real

- Anys 2030: Intel·ligència i energia abundants

Aquestes prediccions tan específiques em recorden les promeses dels cotxes voladors dels anys cinquanta o la colonització de Mart dels noranta. La precisió temporal dona una sensació de credibilitat científica a el que, en realitat, són especulacions empresarials. És la mateixa tàctica que van utilitzar els promotors de la bombolla de les puntocom quan prometien que el comerç electrònic eliminaria les botigues físiques en una dècada, o els evangelistes del blockchain que asseguraven que les criptomonedes substituirien els diners tradicionals abans del 2020.

La diferència és que Altman no és només un visionari tecnològic; és el CEO d’una empresa valorada en més de 80.000 milions de dòlars. Les seves paraules mouen mercats, influeixen en decisions d’inversió i orienten polítiques públiques. Quan parla, el món escolta, i això fa que la seva retórica sigui especialment perillosa.

El mite de la intel·ligència artificial… intel·ligent

Un dels aspectes més problemàtics de l’article és com Altman presenta els sistemes d’IA com si fossin genuïnament intel·ligents. Parla de “cervells per al món” i de sistemes que “aprenen i actuen cap al que col·lectivament volem”. Aquesta antropomorfització és exactament el tipus de llenguatge que confon el públic sobre la veritable naturalesa d’aquests sistemes.

La realitat és que els grans models de llenguatge són extraordinàriament sofisticats en reconèixer patrons i generar text coherent, però no “entenen” res en el sentit humà del terme. Quan Altman afirma que ChatGPT és “més poderós que qualsevol humà”, està comparant una calculadora estadística amb la consciència humana. Són categories completament diferents.

Imaginem que algú digués que una excavadora és “més forta que qualsevol humà que hagi viscut mai”. Tècnicament seria cert, però seria una comparació sense sentit. L’excavadora és una eina; la força humana és quelcom qualitativament diferent. El mateix passa amb la IA: pot processar més informació i generar més text que qualsevol humà, però això no la converteix en més “intel·ligent” en cap sentit meaningful del terme.

L’economia de la promesa tecnològica

Des d’una perspectiva de negoci digital, l’article d’Altman té molt sentit. OpenAI necessita mantenir l’interès dels inversors i justificar les enormes valoracions que ha aconseguit. En un mercat on la capitalització borsària de les empreses d’IA supera el PIB de molts països, vendre una visió d’abundància tecnològica on “el cost de la intel·ligència convergirà cap al cost de l’electricitat” és una narrativa poderosa per als mercats financers.

Però aquesta retòrica té conseqüències reals que van molt més enllà de Wall Street. Empreses de tot el món estan prenent decisions d’inversió basades en aquestes projeccions. Professionals estan reorientant les seves carreres. Governs estan desenvolupant polítiques públiques. I gran part d’això es basa en una comprensió sovint superficial del que realment pot fer la tecnologia actual.

He parlat amb diversos directius que han invertit milions en projectes d’IA després d’assistir a conferències on es presentaven visions similars a la d’Altman. Molts d’aquests projectes han fracassat no per limitacions tècniques, sinó per expectatives irrealistes sobre el que la tecnologia podia aconseguir. El cost humà i econòmic d’aquestes decisions basades en hype és considerable, però rarament es comptabilitza en els balanços trimestrals.

La pressió dels inversors i el cicle de l’exageració

OpenAI ha rebut més de 13.000 milions de dòlars en inversions, amb una valoració que continua pujant després de cada ronda de finançament. Aquesta pressió financera crea incentius perversos: és més fàcil mantenir els inversors contents amb promeses grandioses sobre el futur que amb avaluacions sobres sobre les limitacions actuals.

Altman no està sol en això. Dario Amodei d’Anthropic parla regularment d’“IA que superarà els humans en tots els àmbits”. Demis Hassabis de Google DeepMind promet “AGI (intel·ligència general artificial) en aquesta dècada”. Satya Nadella de Microsoft presenta la IA com “la plataforma més important de la història de la computació”. Tots ells tenen incentius econòmics clars per mantenir aquesta narrativa.

Els bucles d’autoreferència: realitat o ciència-ficció?

Una de les idees més interessants de l’article és el concepte dels “bucles d’auto referència”: IA que ajuda a crear millor IA, robots que construeixen altres robots, sistemes que s’acceleren mútuament. Altman suggereix que els científics ja són “dues o tres vegades més productius” gràcies a la IA.

Aquí hi ha una mica de veritat barrejada amb molt d’exageració. És cert que les eines d’IA poden accelerar certes tasques de recerca i desenvolupament. Investigadors utilitzen models de llenguatge per generar hipòtesis, analitzar literatura científica i automatitzar tasques repetitives. Però el salt conceptual cap a sistemes que es milloren exponencialment de manera autònoma és enorme.

Estem parlant de sistemes que encara cometen errors bàsics de raonament, que no poden distingir entre correlació i causalitat, i que depenen completament de la supervisió humana per a qualsevol tasca significativa. La idea que aquests sistemes puguin auto generar millores científiques revolucionàries és, ara per ara, més ciència-ficció que ciència.

La qüestió de l’alineació: el reconeixement implícit dels límits

Paradoxalment, una de les parts més honestes de l’article és quan Altman parla dels “seriosos reptes a confrontar”, especialment el problema de l’alineació. Reconeix que cal garantir que els sistemes actuïn “cap al que col·lectivament volem realment a llarg termini”.

Aquest reconeixement és important perquè implícitament admet que els sistemes actuals no tenen aquesta capacitat. No poden entendre què volem col·lectivament perquè no entenen res en absolut. Són eines poderoses però cegues, capaços de generar sortides impressionants però incapaces de comprendre el significat o les conseqüències del que produeixen.

El problema de l’alineació és, de fet, un dels majors obstacles per a qualsevol visió utòpica de la IA. Com podem estar segurs que sistemes cada vegada més potents actuaran en el nostre interès si ni tan sols podem estar segurs que entenen què és el nostre interès? És un problema filosòfic i tècnic que està molt lluny de ser resolt, malgrat les afirmacions optimistes d’Altman.

L’automatització dels treballs: optimisme sense base empírica

L’article aborda la qüestió de la destrucció d’ocupacions amb un optimisme que em sembla injustificat. Altman compara la situació actual amb la revolució industrial, suggerint que “descobrirem noves coses a fer i noves coses a voler”. Utilitza l’analogia d’un pagès medieval que consideraria els treballs actuals com “falsos treballs”.

Aquesta comparació històrica és problemàtica per diverses raons. Primer, la revolució industrial va comportar dècades de disrupció social massiva abans que els beneficis es distribuïssin àmpliament. Les condicions de vida dels treballadors industrials van ser terribles durant generacions. Segon, la velocitat del canvi actual és potencialment molt més ràpida que qualsevol transformació històrica anterior.

Tercer, i més important, no hi ha cap garantia que les noves ocupacions que es creïn siguin accessibles per a les persones que perdin la seva feina. Un camioner de cinquanta anys no es pot reconvertir fàcilment en programador d’IA, i les polítiques de reciclatge professional que tenim actualment són clarament inadequades per a l’escala del repte que se’ns presenta.

Els precedents històrics de les prediccions fallides

La història de la tecnologia està plena de prediccions grandioses que mai es van complir. Als anys vuitanta, els experts asseguraven que la fusió nuclear freda revolucionaria l’energia en una dècada. Als noranta, la realitat virtual havia de canviar completament com interactuem amb la informació. Als 2000, els cotxes autònoms havien d’estar per tot arreu abans del 2010.

Moltes d’aquestes tecnologies han acabat tenint impacte, però de manera molt més gradual i limitada del que es predeia inicialment. El patró és sempre el mateix: entusiasme inicial, inversions massives, promeses grandioses, desil·lusió quan la realitat no compleix les expectatives, i finalment adopció gradual amb aplicacions més modestes.

La IA actual sembla seguir aquest mateix patró. Les promeses són enormes, les inversions són massives, però els resultats pràctics són sovint més modestos del que suggereixen les projeccions més optimistes.

Una reflexió sobre el nostre moment tecnològic

El que més em preocupa de textos com aquest no són les prediccions en si —al cap i a la fi, el futur sempre és incert—, sinó l’efecte que tenen sobre la comprensió pública de la tecnologia. Quan els líders tecnològics fan afirmacions grandioses sobre “superintel·ligència” i “singularitats suaus”, contribueixen a crear una atmosfera on el pensament crític sobre la IA esdevé més difícil.

El resultat és una societat que oscil·la entre la fascinació acrítica i la por irracional, quan el que necessitem és una comprensió matisada i realista de les capacitats i limitacions d’aquestes tecnologies. Aquesta polarització fa més difícil tenir converses productives sobre com regular, implementar i utilitzar la IA de manera responsable.

Més enllà del hype: cap a una comprensió realista

No vull minimitzar la importància real de la IA actual. Aquests sistemes són eines poderoses que ja estan transformant molts sectors. Poden automatitzar tasques complexes, accelerar la recerca i millorar la productivitat en molts àmbits. Però també tenen limitacions fonamentals que sovint es passen per alt en els discursos més entusiastes.

Com a societat, necessitem aprendre a distingir entre les capacitats reals d’aquests sistemes i les projeccions especulatives dels seus creadors. Necessitem desenvolupar alfabetització tecnològica que ens permeti avaluar críticament tant les promeses com els riscos.

El futur que realment ens espera

Probablement el futur amb IA serà menys espectacular i més gradual del que suggereix Altman. No viurem una transformació apocalíptica ni una utopia tecnològica, sinó una evolució constant amb beneficis, riscos i reptes que caldrà gestionar col·lectivament.

L’important no és creure o no creure en les prediccions d’Altman, sinó mantenir l’esperit crític davant de qualsevol visió del futur que se’ns presenti com a inevitable. Perquè, al final, el futur el construïm nosaltres amb les decisions que prenem avui. I per prendre bones decisions, necessitem informació precisa, no només somnis ben embolcallats.

La responsabilitat no és només dels líders tecnològics de ser més honestos sobre les limitacions dels seus sistemes, sinó també nostra com a societat de desenvolupar el pensament crític necessari per navegar aquest paisatge complex. Només així podrem aprofitar els beneficis reals de la IA sense caure en les trampes de les seves promeses més grandioses.