Los gemelos digitales: de Barack Obama a Bruce Willis

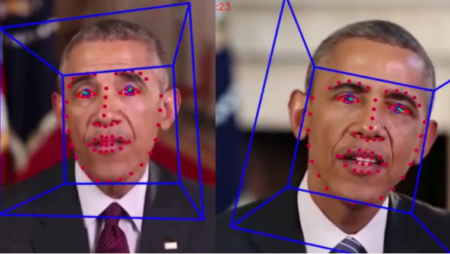

En 2017 unos investigadores de la Universidad de Washington utilizaron más de 14 horas de grabación del presidente Barack Obama para reproducir su imagen y voz, y así simular cualquier discurso. Crearon un modelo de la forma y los movimientos de la boca para vincularlo con las grabaciones de la voz. Con esta técnica, partiendo de vídeos reales podían poner en boca de Barack Obama cualquier mensaje que un actor reprodujera

Recientemente Bruce Willis acaba de convertirse en el primer actor de Hollywood en vender sus derechos sobre la posibilidad de un «gemelo digital» a la firma estadounidense Deepcake , según informa The Telegraph . Con el uso de la tecnología deepfake, Willis ha ofrecido su imagen para que se use en la pantalla para proyectos futuros, luego de su primera experiencia con la manipulación de medios digitales en un comercial del servicio telefónico ruso, MegaFon, el año pasado.

La tecnología deepfake permite que el uso de la imagen de una persona se superponga a la de otro individuo. Mediante el uso de aprendizaje automático e IA, es posible crear un «gemelo» visual y de audio de alguien en videos. Aunque la capacidad de recrear a alguien de manera casi perfecta plantea algunas preguntas éticas, la tecnología ya se ha utilizado en el universo de Star Wars con Rogue One: A Star Wars Story , así como The Mandalorian Season 2. En 2021, Willis dio permiso a Deepcake para aparecer en un comercial, lo que permite que su rostro sea «trasplantado digitalmente a otro artista». Ahora, el actor ha vendido oficialmente los derechos de su imagen para ser esencialmente «contratado» por Deepcake para futuras producciones.

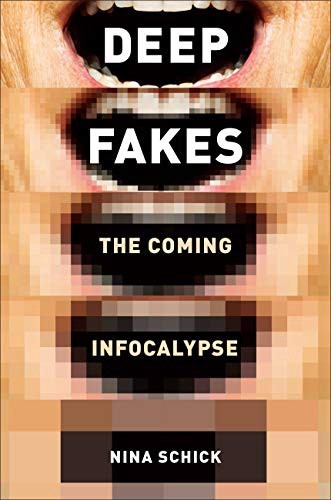

Hay una lectura introductoria sobre el tema: ‘Deepfakes: The Coming Infocalypse’ de Nina Schick:

Deepfake de Nina Schick: el propósito del libro

“Al escribir este libro, mi modesto objetivo es ayudarlo a comprender cuán peligroso y poco confiable se ha vuelto nuestro ecosistema de información, y cómo sus daños se extienden mucho más allá de la política, incluso en nuestra vida privada e íntima. Espero que este entendimiento pueda ayudarnos a unirnos para reforzar nuestras defensas y comenzar a contraatacar. Como sociedad, debemos ser mejores en la construcción de resiliencia al Infocalypse. Entender lo que está pasando es el primer paso”.

– Nina Schick

De la IA al Deepfake

Pronto será imposible saber qué es real y qué es falso. Los avances recientes en IA significan que al escanear imágenes de una persona (por ejemplo, usando Meta), un poderoso sistema de aprendizaje automático puede crear nuevas imágenes de video y colocarlas en escenarios y situaciones que en realidad nunca sucedieron. Cuando se combina con una potente IA de voz, los resultados son totalmente convincentes. Los llamados ‘Deep Fakes’ no solo son una amenaza real para la democracia, sino que llevan la manipulación de los votantes a nuevos niveles. También afectarán a la gente común. Esta crisis de desinformación a la que nos enfrentamos ha sido bautizada como el ‘infocalipsis’.

Definición de deepfake

Nina define un deepfake de manera sucinta: «Un deepfake es un tipo de ‘medios sintéticos’, es decir, medios (que incluyen imágenes, audio y video) que son manipulados o generados en su totalidad por IA». Y a partir de sus palabras, parece claro que el concepto de que «hay que verlo para creerlo» ya no puede ser cierto. El desarrollo estratosférico de la IA (Inteligencia Artificial) impacta nuestras vidas, tiene la capacidad de producir contenido, comunicarse e interpretar para nosotros y como resultado puede ser y está siendo explotada para propósitos mucho más nefastos. Nina expone sus puntos sobre este asunto hábilmente e ilustra cuándo y cómo han ocurrido tales instancias con ejemplos en vivo del incidente del MH-17 ruso, las hábiles manipulaciones de Trump, el Brexit y más allá, y lo hace de una manera eminentemente legible.

Nina es muy clara en su delimitación entre la desinformación, que es información/medios fabricados con una intención maliciosa, en contraste con la información errónea, que es simplemente mala información (como material mal contextualizado o editado) pero que no es malicioso. El principal poder de la desinformación radica en el hecho de que puede usarse para ganar argumentos influyentes dentro de la arena política, en temas como; raza, género, igualdad, Brexit, Covid-19.

En última instancia, contamina nuestro ecosistema de información y elimina nuestra realidad compartida de la que no puede haber base para una conversación sensata. Lo que hace que cualquier tipo de terreno común sea imposible de determinar o permitirnos avanzar y comprometernos en algunos asuntos de gran impacto y si no podemos hacer eso, ¿qué sucede?

Nina ha explorado este tema y ha extrapolado conceptos tan técnicos y complicados en secciones digeribles para que todos las entiendan. Aquí también hay un nivel de valentía, para decir abiertamente que esto es lo que sucedió en este evento, así es como sucedió y cómo se manipulan las redes sociales y cómo hemos sido y continuamos siendo engañados y es solo siendo diligentes y conscientes de la influencia que tiene Deepfake, tenemos la oportunidad de minimizar el impacto de niveles tan grandes de malignidad dentro de nuestro ecosistema de información.

Un problema global

El Infocalypse es un problema global y las «libertades de la era de la información no son inherentemente buenas», de hecho, pueden ser francamente mortales. Este libro aporta un mejor conocimiento de los matices de los temas y una comprensión más clara de la taxonomía, el lenguaje y los problemas que lo rodean.

Deepfake amenaza a la democracia

En ‘Deepfakes: The Coming Infocalypse’ Nina Schick nos advierte con urgencia de la inminente sobrecarga de información (conocida como ‘Infocalypse’) y explica las peligrosas consecuencias políticas de este Infocalypse, tanto en términos de seguridad nacional como de lo que significa para la confianza pública en la política. Deep Fakes ha existido por menos de tres años, para silenciar y para venganza y fraude. El gobierno, las empresas y la sociedad están completamente desprevenidos.

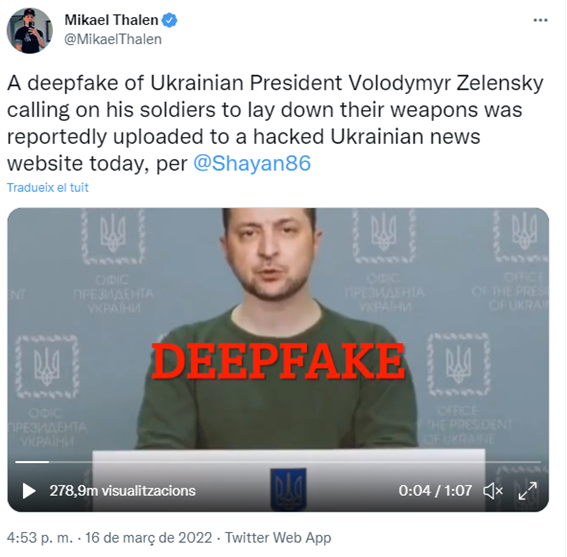

Tenemos numerosos ejemplos a nuestro aldedor, sin ir muy lejos, el vídeo del presidente de Ucrania pidiendo supuestamente a sus tropas que se rindan: un ‘deepfake’ al que Zelenski ya ha respondido.

Schick también revela lo que significa para nosotros como individuos, cómo se usarán los Deep Fakes para intimidar y silenciar, para vengarse y cometer fraude, y cuán poco preparados están los gobiernos y las empresas tecnológicas.

El uso malicioso de Deep Fakes no solo es una amenaza real para la democracia, sino que lleva la manipulación de los votantes a nuevos niveles. Con las elecciones estadounidenses inminentes y con las grandes cantidades de dinero que se gastan en las redes sociales, se espera que Deep Fakes se convierta en una gran historia a finales de este año: el contenido falso generado por IA está aquí para siempre, y tendremos que descubrir cómo. navegar por un mundo donde ver ya no es creer.

Schick está a la vanguardia de las tendencias que surgen de los mundos de la ciencia de datos, el aprendizaje automático y la IA. En Deep Fakes nos dice qué debemos hacer para prepararnos y protegernos.

“Con demasiada frecuencia construimos la tecnología genial e ignoramos lo que los malos pueden hacer con ella antes de comenzar a ponernos al día. Pero cuando se trata de Deep Fakes, necesitamos urgentemente estar a la vanguardia”.

Deepfakes es una lectura obligatoria para cualquiera que se preocupe por ser un ciudadano informado. No es un libro que te hará sentir mejor sobre el futuro. Pero te preparará para los tiempos confusos en los que vivimos.

Deepfakes contra las mujeres

Un informe publicado en septiembre de 2019 por Deeptrace, que desarrolla herramientas para detectar deepfakes, encontró un total de 14.678 videos deepfakes en línea, el 96 por ciento de los cuales eran de naturaleza pornográfica. En los cinco principales sitios de pornografía falsa, el 100% de los videos, que generalmente funcionan superponiendo la cara de una persona en el cuerpo de un actor porno para que parezca que están participando en un acto sexual, presentaban mujeres.

Al igual que la llamada pornografía de venganza (un eufemismo bastante lascivo para describir el acto de compartir maliciosamente las imágenes íntimas de una persona sin su consentimiento), la pornografía falsa se utiliza como herramienta para humillar, degradar y silenciar a las mujeres. Cuando las voces de las mujeres son silenciadas simplemente porque son mujeres; cuando las mujeres son humilladas por ser mujeres; cuando las mujeres son subyugadas porque son mujeres, todo esto representa una amenaza para la democracia. Una tecnología empleada con estos fines es una amenaza para la democracia. El hecho de que no lo veamos de inmediato de esa manera solo refleja cuán insidioso puede ser este tipo de misoginia.

Ya hemos visto ejemplos del mundo real de pornografía ultrafalsa que se usa explícitamente para silenciar y desacreditar las voces de las mujeres y evitar que participen en política. La periodista de investigación india Rana Ayyub, que no es ajena a los abusos en línea, fue víctima de un deepfake pornográfico difundido en WhatsApp, Twitter, Facebook e Instagram en un claro intento de desacreditar su trabajo y humillarla hasta el silencio. Ayyub fue acosada y engañada por la parte posterior del deepfake, y dice que desde entonces ha sido mucho más cautelosa con lo que publica online.

Optimismo: la tecnología resuelve los problemas creados por la tecnología

Mi optimismo proviene del hecho de que somos conscientes del problema y muchos se están movilizando para solucionarlo. A medida que más personas aprenden con qué facilidad se puede manipular la información, eso puede provocar un aumento del escepticismo. Mientras ese escepticismo sea saludable y no se convierta en cinismo perezoso toda esta falsificación podría llevar a un pensamiento más crítico.

La buena noticia es que numerosas de que los investigadores están desarrollando métodos para detectar videos falsos. Por ejemplo, la Universidad de Berkeley de California analiza varios videos para comparar la inclinación de la cabeza, las cejas y el movimiento de la barbilla con tasas de éxito del 92 % al 96 % en la detección de videos falsos profundos.

Las grandes empresas de tecnología, como Google y Meta, tendrán que tomar medidas contra las falsificaciones profundas y las cuentas falsas, o se arriesgarán a enfrentar multas enormes. La nueva regulación de la UE, respaldada por la Ley de Servicios Digitales (DSA), exigirá que las empresas tecnológicas se ocupen de estas formas de desinformación en sus plataformas. Las empresas pueden recibir multas de hasta el 6% de su facturación global si no cumplen.

El código reforzado tiene como objetivo evitar beneficiarse de la desinformación y las noticias falsas en sus plataformas, así como aumentar la transparencia en torno a la publicidad política y frenar la propagación de «nuevos comportamientos maliciosos» como bots, cuentas falsas y falsificaciones profundas.

Clubhouse, Google, Meta, TikTok, Twitter y Twitch se encuentran entre los 33 signatarios del código mejorado y trabajaron juntos para acordar las nuevas reglas. Las empresas que se hayan suscrito al código se verán obligadas a compartir más información con la UE, y todos los signatarios deberán proporcionar informes iniciales sobre su implementación del código para principios de 2023.

Las plataformas con más de 45 millones de usuarios activos mensuales en la UE deberán informar a la Comisión cada seis meses.